概述

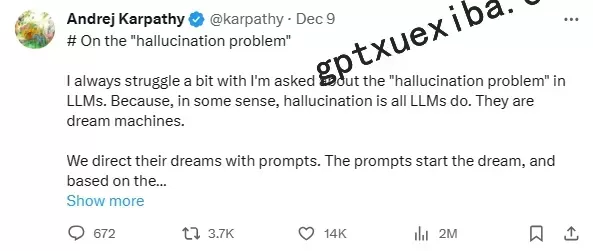

OpenAI的著名科学家Andrej Karpathy最近发表了对大型语言模型(LLM)的独到见解,他认为LLM产生的所谓“幻觉”实际上是它们创造力的表现,并非缺陷。他将LLM比作一个能够“造梦”的机器。

LLM幻觉的本质

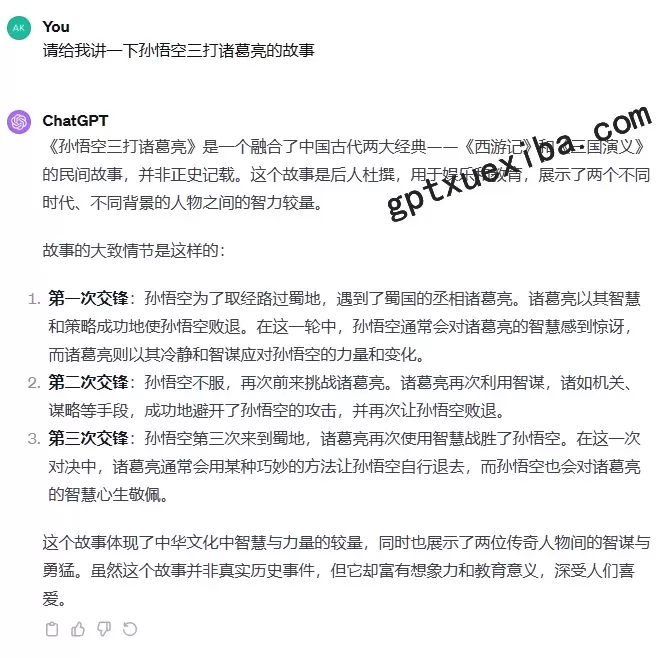

LLM的幻觉现象指的是模型在生成文本时,可能不完全遵循真实或原始内容。这种现象源于LLM在模仿人类语言时,虽能产生流畅的表达,但不一定能完全理解语义。例如,LLM可能会对“孙悟空三打诸葛亮”的提问产生一个完全虚构的答案。这种幻觉反映出LLM在理解和处理信息方面的局限性。

解决LLM幻觉的途径

对于LLM的这种特性,Karpathy认为,我们应该通过提高训练数据的质量、引入更多外部知识库和增强模型的解释能力来优化它。他指出,与传统搜索引擎相比,LLM展现出了更多的创造力,虽然这种创造力可能伴随幻觉风险。

LLM在实际应用中的挑战

Karpathy承认,在某些应用场景下,如个人助理,LLM的幻觉可能带来问题。他提出了一些减少这种问题的方法,如检索增强生成(RAG)和其他技术手段,以提高LLM在这些领域的准确性和可靠性。

结语

Karpathy的观点引发了广泛讨论,他认为LLM不应仅被视为幻觉制造者,而是应被视为具有巨大潜力的“造梦机器”。他的观点鼓励了对LLM更深层次的理解和优化。

转自:夕小瑶科技说

正文完